เบราว์เซอร์อัจฉริยะ หรือการติดตั้งที่ผู้ใช้ไม่ได้เลือก?

เผยแพร่เมื่อ : พุธ 6 พฤษภาคม 2569 โดย สุพิชฌาย์ ถาวรลิมปะพงศ์ จำนวนผู้เข้าชม 13 คน

เมื่อ AI แอบย้ายเข้ามาอยู่ในเครื่องเรา: คำถามใหญ่เรื่อง “สิทธิผู้ใช้” ในยุคเบราว์เซอร์อัจฉริยะ

ในยุคที่ AI เข้ามามีบทบาทในชีวิตประจำวัน เราอาจไม่รู้ตัวเลยว่า “ผู้ช่วยอัจฉริยะ” บางตัวไม่ได้ทำงานอยู่บนระบบคลาวด์เพียงอย่างเดียวอีกต่อไป แต่อาจถูกดาวน์โหลดและติดตั้งลงมาอยู่ในเครื่องของเราเรียบร้อยแล้ว โดยที่ผู้ใช้จำนวนมากแทบไม่รู้ตัว

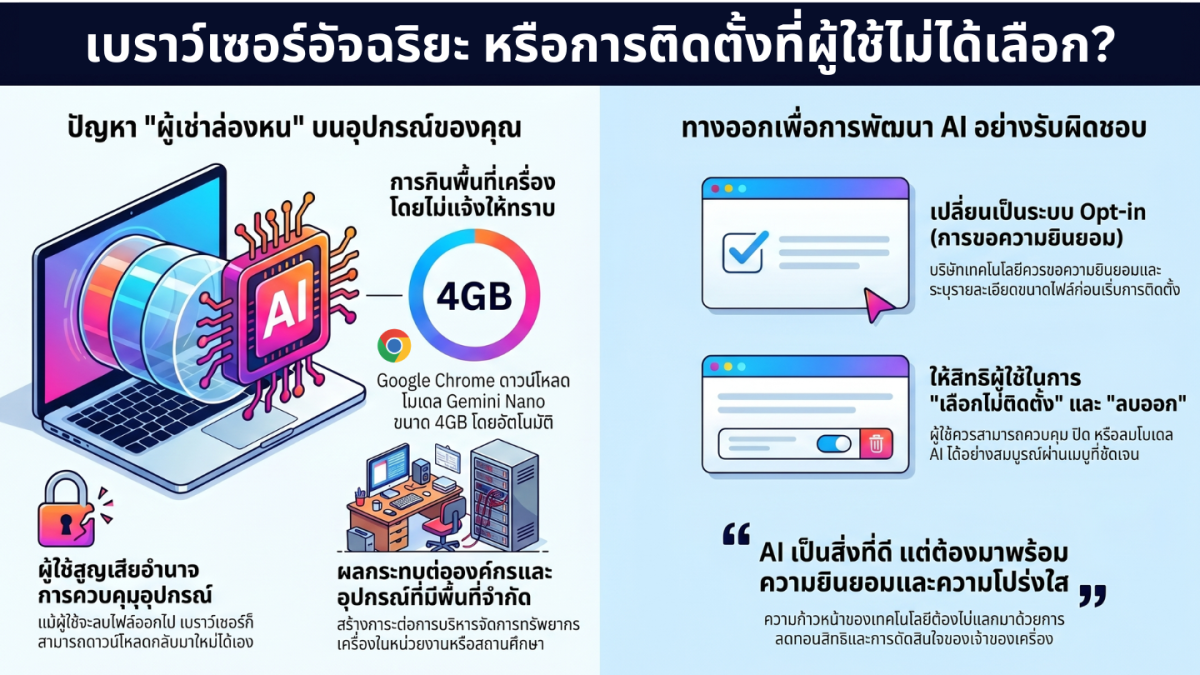

ประเด็นนี้กลายเป็นที่พูดถึงอย่างมาก หลังมีรายงานว่า Google Chrome ได้ดาวน์โหลดโมเดล AI ขนาดใหญ่ประมาณ 4GB ลงในเครื่องผู้ใช้แบบอัตโนมัติ โดยไฟล์ดังกล่าวถูกระบุว่าเป็นโมเดล Gemini Nano ซึ่งเป็นโมเดล AI สำหรับการประมวลผลบนอุปกรณ์โดยตรง หรือที่เรียกว่า On-device AI เพื่อรองรับฟีเจอร์อัจฉริยะบางอย่าง เช่น การช่วยเขียนข้อความ การสรุปเนื้อหา หรือฟีเจอร์ AI อื่น ๆ ที่ทำงานได้รวดเร็วขึ้นโดยไม่ต้องส่งข้อมูลไปประมวลผลบนเซิร์ฟเวอร์ตลอดเวลา

ในเชิงเทคนิค แนวคิดนี้ถือว่าน่าสนใจ เพราะการให้ AI ทำงานบนเครื่องโดยตรงสามารถช่วยเพิ่มความเร็ว ลดการพึ่งพาอินเทอร์เน็ต และอาจช่วยเพิ่มความเป็นส่วนตัวได้มากกว่าการส่งข้อมูลทุกอย่างขึ้นไปประมวลผลบนคลาวด์ แต่สิ่งที่ทำให้เรื่องนี้กลายเป็นประเด็นร้อน ไม่ใช่เพราะ AI ไม่มีประโยชน์ หากแต่เป็นเรื่องของ “กระบวนการ” ที่ผู้ใช้จำนวนมากมองว่าไม่โปร่งใสพอ

คำถามสำคัญคือ ใครเป็นคนตัดสินใจว่าเครื่องของผู้ใช้ควรถูกติดตั้งโมเดล AI ขนาดใหญ่ลงไปโดยอัตโนมัติ?

สำหรับผู้ใช้บางคน พื้นที่จัดเก็บข้อมูล 4GB อาจไม่ใช่ปัญหาใหญ่ แต่สำหรับอุปกรณ์ที่มีพื้นที่จำกัด หรือเครื่องคอมพิวเตอร์ในองค์กรที่ต้องควบคุมซอฟต์แวร์อย่างเข้มงวด พื้นที่ขนาดนี้ถือว่ามีความหมายมาก ยิ่งไปกว่านั้น มีรายงานว่าแม้ผู้ใช้จะลบไฟล์ดังกล่าวออกไป Chrome ก็สามารถดาวน์โหลดกลับมาใหม่ได้เอง ทำให้เกิดความรู้สึกว่าผู้ใช้กำลังสูญเสียอำนาจในการควบคุมอุปกรณ์ของตนเอง

ประเด็นนี้จึงไม่ใช่เพียงเรื่อง “AI ดีหรือไม่ดี” แต่เป็นเรื่องของ “สิทธิในการรับรู้และสิทธิในการเลือก” ผู้ใช้ควรได้รับข้อมูลอย่างชัดเจนว่า ซอฟต์แวร์กำลังจะดาวน์โหลดอะไร ขนาดเท่าใด ใช้เพื่อฟีเจอร์ใด เก็บไว้ที่ไหน ใช้ทรัพยากรเครื่องอย่างไร และสามารถปฏิเสธได้หรือไม่

ในช่วงเวลาใกล้เคียงกัน ยังมีการกล่าวถึงกรณีของ Claude Desktop จาก Anthropic ซึ่งมีผู้ตั้งข้อสังเกตเกี่ยวกับการติดตั้งองค์ประกอบบางอย่างลงในเครื่องผู้ใช้โดยไม่มีการสื่อสารที่ชัดเจนเพียงพอ แม้รายละเอียดของแต่ละกรณีจะแตกต่างกัน แต่ทั้งสองกรณีสะท้อนปัญหาเดียวกัน คือบริษัทเทคโนโลยีกำลังเร่งนำ AI เข้าไปอยู่ใกล้ผู้ใช้มากขึ้นเรื่อย ๆ ขณะที่กระบวนการขอความยินยอมและการให้ผู้ใช้ควบคุมกลับยังตามไม่ทัน

สำหรับ Google Chrome ประเด็นนี้มีน้ำหนักมากเป็นพิเศษ เพราะ Chrome ไม่ใช่ซอฟต์แวร์เฉพาะกลุ่ม แต่เป็นเว็บเบราว์เซอร์ที่มีผู้ใช้งานจำนวนมหาศาลทั่วโลก การเปลี่ยนแปลงใด ๆ ที่เกิดขึ้นกับ Chrome จึงไม่ได้กระทบแค่ผู้ใช้รายบุคคล แต่ยังส่งผลถึงองค์กร สถานศึกษา หน่วยงานภาครัฐ และระบบนิเวศดิจิทัลโดยรวม

ในมุมของผู้ใช้ สิ่งที่สามารถทำได้ในปัจจุบันคือการสังเกตความผิดปกติของพื้นที่จัดเก็บข้อมูล ตรวจสอบว่าโฟลเดอร์ของ Chrome หรือแอปพลิเคชันที่เกี่ยวข้องมีขนาดเพิ่มขึ้นผิดปกติหรือไม่ รวมถึงสังเกตว่ามีฟีเจอร์ AI ใหม่ ๆ เช่น การช่วยเขียนหรือการสรุปข้อความ ปรากฏขึ้นมาโดยที่ผู้ใช้ไม่ได้เลือกเปิดใช้งานเองหรือไม่ อย่างไรก็ตาม ข้อจำกัดสำคัญคือ ปัจจุบันผู้ใช้ทั่วไปอาจยังไม่มีเมนูที่ชัดเจนสำหรับ “เลือกไม่ติดตั้ง” หรือ “ปิดการดาวน์โหลดโมเดล AI” ได้อย่างสมบูรณ์

ทางออกที่เหมาะสมจึงไม่ใช่การหยุดพัฒนา AI แต่คือการพัฒนา AI อย่างโปร่งใสและเคารพผู้ใช้มากขึ้น บริษัทเทคโนโลยีควรใช้ระบบ Opt-in หรือการขอความยินยอมก่อนติดตั้ง โดยแจ้งอย่างตรงไปตรงมาว่า “Chrome ต้องการดาวน์โหลดไฟล์ AI ขนาดประมาณ 4GB ลงในอุปกรณ์ของคุณ เพื่อรองรับฟีเจอร์ต่อไปนี้ คุณต้องการอนุญาตตอนนี้ หรือข้ามไปตัดสินใจภายหลัง” ข้อความลักษณะนี้อาจดูเรียบง่าย แต่ในเชิงความไว้วางใจ ถือเป็นเรื่องสำคัญอย่างยิ่ง

นอกจากนี้ ควรมีตัวเลือกให้ผู้ใช้ติดตั้งเฉพาะเมื่อจำเป็นต้องใช้ฟีเจอร์ AI จริง ๆ ไม่ใช่ดาวน์โหลดให้ทุกคนโดยอัตโนมัติ และควรมีช่องทางให้ผู้ใช้สามารถลบ ปิด หรือควบคุมการทำงานของโมเดล AI บนเครื่องได้อย่างชัดเจน โดยเฉพาะในสภาพแวดล้อมขององค์กรที่ต้องบริหารจัดการความปลอดภัย ข้อมูล และทรัพยากรของเครื่องอย่างเป็นระบบ

ท้ายที่สุด AI ไม่ใช่สิ่งที่น่ากลัว หากถูกพัฒนาและใช้งานอย่างเหมาะสม ตรงกันข้าม AI สามารถช่วยให้การทำงานรวดเร็วขึ้น สะดวกขึ้น และปลอดภัยขึ้นได้จริง แต่ความก้าวหน้าทางเทคโนโลยีไม่ควรเกิดขึ้นด้วยการลดทอนสิทธิของผู้ใช้

สาระสำคัญของเรื่องนี้จึงสรุปได้ว่า AI เป็นสิ่งที่ดี แต่ต้องมาพร้อมกับความยินยอม ความโปร่งใส และความรับผิดชอบ เพราะอุปกรณ์ของผู้ใช้ไม่ควรถูกมองเป็นเพียงพื้นที่สำหรับติดตั้งเทคโนโลยีใหม่ ๆ โดยปราศจากการรับรู้และการตัดสินใจของเจ้าของเครื่องเอง

หากบริษัทเทคโนโลยีสามารถทำให้คำว่า “AI อย่างมีความรับผิดชอบ” เป็นแนวปฏิบัติจริง ไม่ใช่เพียงถ้อยคำทางการตลาด นั่นจะเป็นก้าวสำคัญที่ทำให้ผู้ใช้ยอมรับ AI ด้วยความไว้วางใจ ไม่ใช่ด้วยความจำใจ.

ที่มา: entechreview.com

- ประกาศ สวส. (หอสมุด) มทร.ล้านนา แนวทางการทดลองปฏิบัติงาน...

- ประกาศ สวส.มทร.ล้านนา : วันและเวลาให้บริการ เดือนพฤษภาคม...

- เบราว์เซอร์อัจฉริยะ หรือการติดตั้งที่ผู้ใช้ไม่ได้เลือก?

- สวส.มทร.ล้านนา (งานหอสมุด) : แจ้งปิดปรับปรุงเว็บไซต์ Web...

- ๕ พฤษภาคม วันคล้ายวันประสูติ พระเจ้าวรวงศ์เธอ พระองค์เจ้...

- วันฉัตรมงคล ๔ พฤษภาคม

ออกแบบและพัฒนาโดย สำนักวิทยบริการและเทคโนโลยีสารสนเทศ มหาวิทยาลัยเทคโนโลยีราชมงคลล้านนา